插帧补帧DAIN算法,让电影、视频、动漫变丝滑顺畅

连手机都开始用上120帧的显示屏,但是网上大部分的视频居然还是30帧。

视频的帧率已经远远赶不上人民群众的需求了,所以有不少人都在研究如何把普通视频变成高帧率视频。

去年,英伟达开源了Super SloMo,从普通的视频“脑补”出高帧率的画面,从30fps插帧到240fps,即使放慢8倍也不会感到卡顿。

B站针对所有UP主已经首家开放120帧视频特效,而能够拍摄120fps的主流硬件都很昂贵,有没有一种技术手段可以解决这个问题?

最近,来自上海交大的一个新的插帧算法DAIN开源。它比英伟达的算法效果更清晰、帧率更高,可以把30fps的进一步插帧到480fps,这已经超过了很多手机的慢动作录像帧率。

更重要的是,英伟达的Super SloMo只用在了真实拍摄的视频上,而这项研究却可以扩展到常见的任何类型视频:电影、定格动画、动漫卡通等等。

连埼玉老师的披风都变得丝滑流畅了

如果你觉得上面效果还不够明显,可以再看一张。

羽毛的摆动是不是变得更流畅自然了?

可以想象,如果未来把DAIN用于动漫的制作,只要用低帧的动画就可以生成丝滑的效果,或许能大大减少插画师的工作。

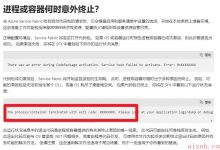

平台的用户安装起来也不复杂。

首先确保你的PyTorch版本不低于1.0.0,将项目克隆到本地:

gitclonehttps://github.com/baowenbo/DAIN.git

即使没有任何AI基础的用户也可以使用以下平台来使用这个工具:http://distinctai.net/fps

作者已经提供了预训练模型,我们不必再花费大量精力去训练。

深度加光流,图像更清晰

之前已经有很多给视频插帧的算法,DAIN和它们有什么不同呢?

DAIN的全称是Depth-Aware Video Frame Interpolation,即深度感知视频帧插值。

视频帧插值的目的是在原始帧之间合成不存在的帧。但是由于大的物体运动或遮挡,插帧的质量通常会比较低。

在这篇研究中,研究人员提出了一种通过探索深度信息来检测遮挡的方法。

具体来说,作者开发了一个深度感知光流投影层来合成中间流,中间流对较远的对象进行采样。此外,学习分层功能以从相邻像素收集上下文信息。

上图是DAIN的体系架构:给定两个时刻的输入帧,先估计光流和深度图,然后使用建议的深度感知流投影层生成中间流。

然后,模型基于光流和局部插值内核对输入帧、深度图和上下文特征进行扭曲,合成输出帧。

这种模型紧凑、高效且完全可微分。定量和定性的结果表明,DAIN在各种数据集上均优于最新的帧插值方法。

爱站程序员基地

爱站程序员基地

![[翻译] Backpressure explained — the resisted flow of data through software-爱站程序员基地](https://aiznh.com/wp-content/uploads/2021/05/6-220x150.jpeg)